محققان یک مدل یادگیری ماشین را آموزش می دهند تا بتواند عملکردی هم سطح انسان در شناخت مفاهیم انتزاعی موجود در فیلم ها داشته باشد.

توانایی استدلال انتزاعی درباره وقایع لحظهای یکی از شاخصهای تعیینکننده هوش انسانی است. ما بهطور غریزی میدانیم که گریه کردن و نوشتن، ابزارهایی برای برقراری ارتباط هستند و پاندایی که از روی درخت سقوط میکند و هواپیمایی که فرود میآید نشانگر کم شدن شاخص ارتفاع است. کامپیوترها از عهده دستهبندی جهان در طبقات انتزاعی بر نمیآیند اما در سالهای اخیر محققان با آموزش مدلهای یادگیری به این هدف نزدیکتر شدهاند. این مدلها در مورد کار روی کلمات و تصاویری که با اطلاعات دنیای پیرامونمان ترکیب شدهاند و چگونگی ارتباط اشیاء، حیوانات و کنشها و رفتارهای ما است.

در یک مطالعه جدید که در کنفرانس اروپایی بینایی ماشین در ماه گذشته برگزار شد ، محققان از یک مدل ترکیبی از بینایی ماشین و پردازش زبان طبیعی رونمایی کردند که میتواند مجموعهای از رویدادهای پویای ضبط شده در فیلم را با هم مقایسه کند یا تضاد بین آنها را نشان دهد تا به مفاهیم سطح بالایی که آنها را به هم متصل میکند، پی برد. مدل آنها در دو نوع استدلال بصری، یا به خوبی انسان عمل کرده یا بهتر از انسانها بوده است؛ انتخاب ویدئویی که بهطور مفهومی به بهترین شکل مجموعه را کامل میکند و انتخاب ویدئویی که مناسب نیست.

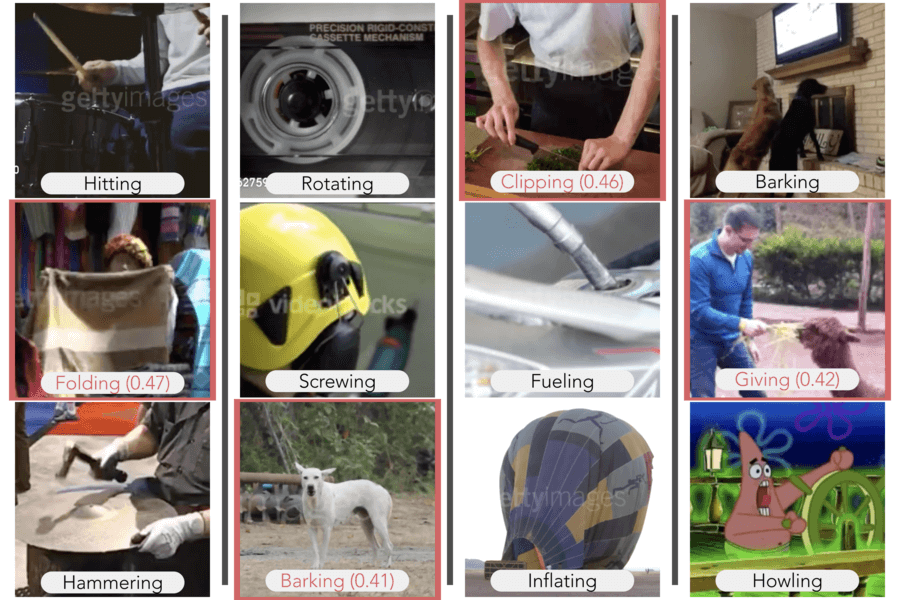

به عنوان مثال فیلمهایی از پارس کردن یک سگ و زوزه کشیدن یک مرد در کنار سگ خود را به سیستم نشان دادند و مدل برای کامل کردن این مجموعه از تصاویر از بین ۵ کلیپ، ویدیوی مربوط به گریه کردن یک کودک را انتخاب کرد. محققان نتایج خود را در دو دیتاست برای آموزش سیستمهای هوش مصنوعی در تشخیص عمل تکرار کردند: MIT’s Multi-Moments in Time و Deep Mind’s Kinetics.

آود اولیوا نویسنده ارشد این مقاله که دانشمند ارشد تحقیقات در MIT است دراینباره میگوید: “ما نشان دادیم که شما میتوانید توانایی درک مفاهیم انتزاعی را در سیستمهای هوش مصنوعی ایجاد کنید تا بتوانند کارهای مربوط به استدلال بصری را در سطحی نزدیک به سطح انسانها انجام دهند. مدیر آزمایشگاه هوش مصنوعی MIT-IBM Watson نیز میگوید “مدلی که بتواند وقایع و مفاهیم انتزاعی را تشخیص دهد پیشبینیهای منطقی و دقیقتری را ارائه میدهد و برای تصمیمگیری مفیدتر است.”

همزمان که شبکههای عصبی عمیق در تشخیص اشیاء و کنشهای موجود در عکسها و فیلمها توانمندتر میشوند، محققان در حال کار روی نقطه عطف بعدی هستند؛ یعنی انتزاع و آموزش مدلها برای آنکه بتوانند درباره آنچه میبینند استدلال کنند. در یک رویکرد، محققان قدرت تطبیق الگوهای شبکههای عمیق را با منطق برنامههای نمادین تلفیق کردهاند تا یک مدل آموزش دهند که بتواند روابط پیچیده اشیا را در یک صحنه تفسیر کند. رویکرد دیگر این است که محققان از روابط موجود در معنای کلمات بهره ببرند تا به مدل خود قدرت استدلال بصری دهند.

ماتیو مونفورت یکی از نویسندگان این مقاله که از محققان آزمایشگاه علوم رایانهای و هوش مصنوعی MIT است میگوید: “بازنماییهای زبانی به ما امکان میدهد تا اطلاعات متنی آموختهشده از پایگاه دادههای متنی را در مدلهای تصویری خود ادغام کنیم. کلماتی مانند دویدن، بلندکردن و بوکس دارای برخی از ویژگیهای مشترک هستند که باعث میشود آنها را بیشتر به مفهوم ورزش نزدیک کند تا رانندگی.

محققان با استفاده از WordNet که یک پایگاه دادهای از معانی کلمات است، رابطه هربرچسب موجود در دو دیتاست Moments و Kinetics را با سایر برچسبهای هر دو دیتاست ترسیم کردند. بهعنوانمثال کلماتی مانند مجسمهسازی، کندهکاری و برش به مفاهیم سطح بالاتری همچون صنایعدستی، هنر و آشپزی مرتبط شدند. ازاین پس هرگاه مدل فعالیتی مانند مجسمهسازی را تشخیص دهد، میتواند فعالیتهای مشابه مفهومی را در دیتاست انتخاب کند.

این گراف وابستگی مربوط به طبقههای انتزاعی برای آموزش مدل به منظور انجام دو کار اساسی استفاده میشود. با توجه به مجموعهای از ویدئوها، مدل به هر ویدیو عددی اختصاص میدهد که با همان کلماتی که بیانگر اقدامات نشان دادهشده در ویدئو است همسو هستند. سپس یک ماژول انتزاعی با عدد اختصاص دادهشده به هر ویدئو در مجموعه ترکیب میشود تا شماره اختصاصی مجموعه جدید ایجاد شود. به این ترتیب از این میتوان برای شناسایی دیگر مفاهیم انتزاعی به اشتراک گذاشتهشده از طریق همه فیلمهای مجموعه استفاده شود.

محققان برای سنجش نحوه عملکرد این مدل در مقایسه با انسانها، از افراد خواستند که همان مجموعه وظایف استدلال بصری را که مدل انجام داده بهصورت آنلاین انجام دهند. در کمال تعجب، این مدل در بسیاری از سناریوها عملکردی بهخوبی برخی از انسانها داشت و حتی گاهی اوقات نتایج غیرمنتظره بود. در یک سنجش دیگر، به مدل ویدیویی از فردی که در حال کادو کردن است نشان دادند سپس مدل ویدیویی را از فردی در ساحل نشان میدهد که در حال ریختن ماسه بر روی شخص دیگری است. کامیلو فوسکو، دانشجوی دکترای MIT که نویسنده اول این مقاله است میگوید: این مفهوم پوشاندن را بهخوبی نشان میدهد.

تمایل به تأکید بیش از حد روی برخی از ویژگیها از معایب و محدودیتهای این مدل است. بهطور مثال در یک مورد مدل پیشنهاد داد مجموعهای از فیلمهای ورزشی را میتوان با یک فیلم از یک کودک و یک توپ تکمیل کند که نشان میدهد مدل، توپها را همواره با ورزش و رقابت همراه میکند.

محققان میگویند یک مدل یادگیری عمیق که میتواند برای “فکر کردن” بهصورت انتزاعی آموزش ببیند ممکن است بتواند با دادههای کمتری نیز قابلیت یادگیری را داشته باشد. بهطورکلی انتزاع راه را برای استدلالهای سطح بالاتر و انسانیتر باز میکند.

اولیوا میگوید: یکی از ویژگیهای بارز شناخت انسان این است که میتواند چیزهای مختلف را در رابطه باهم توصیف و مقایسه کند یا تضاد بین آنها را مشخص نماید. این یک روش غنی و کارآمد برای یادگیری است که درنهایت میتواند به انواع مدل یادگیری ماشین آموزش داده شود تا قیاسها را درک کنند و ازنظر هوشمندی بسیار به ما نزدیکتر هستند.

منبع: hooshio.com

مجله هوش مصنوعی محققان ,انتزاعی ,آموزش ,نشان ,استدلال ,میتواند ,مفاهیم انتزاعی ,یادگیری ماشین ,نشان میدهد ,استدلال بصری ,انجام دهند منبع

درباره این سایت